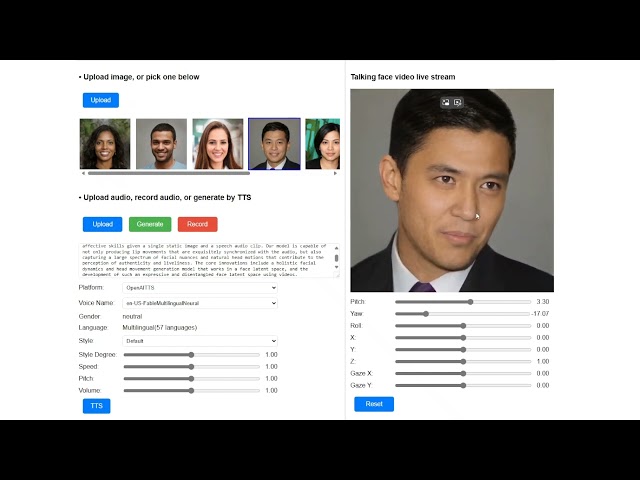

Разработанное Microsoft ПО на основе генеративного ИИ VASA позволяет создавать невероятно реалистичные видео по единственному фото оригинала и небольшому отрывку аудиозаписи с его голосом. Кроме того, ПО может менять местами лица людей на созданном видео в реальном времени. VASA не только имитирует выражение лиц, но и дополняет видео реалистичными движениями головы и глаз.

Разработчики отмечают не только высокое качество создаваемых дипфейков — но и несовершенство работы ИИ. Если присмотреться к видео, можно заметить артефакты, указывающие, что это фейк. Например, зубы аватаров отображаются неправильно, напоминая гармошку. Есть и другие особенности, которые мозг не улавливает, но воспринимает как нечто аномальное. Но все это заметно только при внимательном изучении сгенерированных видео. Обычный наблюдатель этого, скорее всего, не заметит.

Система может работать не только с фото, но и с уже сгенерированными портретами или картинками. Например, ему по силам спеть песню «Paparazzi» голосом Энн Хэтэуэй с аватаром Моны Лизы. Возможности VASA вызывают вполне оправданные опасения, но в Microsoft пока не представили инструментов для противодействия возможным злоупотреблениям. Единственным позитивным моментом можно считать то, что разработчики не собираются делать доступ к VASA открытым. Если допустить, что использование платформы будет ответственным, у нее может найтись несколько интересных применений в рамках даже действующих законов.